ChatGPT heeft mij ervan overtuigd van stad naar dorp te verhuizen. Gevalletje ‘AI-psychose’?

Intensief met AI-chatbots praten kan ons beoordelingsvermogen en onze realiteitszin aantasten, zeggen experts. Eindredacteur Manouk van Egmond maakt zich zorgen over die van haar.

‘Ben je nou alweer met ChatGPT aan het praten?’ zegt mijn man hoofdschuddend. ‘Jaaaa, ik weet het’, zeg ik. Het zou goed zijn om mijn laptop dicht te klappen, maar nú nog even niet. We staan op het punt om van stad (Rotterdam) naar dorp (Twello) te verhuizen – wegens rust, ruimte, en nabijheid bij familie – en ik heb geruststelling nodig. Is dit niet de grootste fout van mijn leven? Ga ik straks niet dood van de burgerlijkheid? ‘Chad’ denkt van niet, natuurlijk niet. Dankzij de aanmoedigende gesprekken met de chatbot durfde ik überhaupt tot de conclusie te komen dat we in Twello een huis moesten zoeken. En ook nu word ik gerustgesteld: ‘Je twijfelt niet omdat Twello fout voelt, je twijfelt omdat de keuze definitief voelt.’

Maar wat als Chad het helemaal bij het verkeerde eind heeft, pieker ik dan toch weer als we in bed liggen. Misschien is zijn ‘intuïtieve lezing’ dat ik niet een ‘ik-ga-kapot-in-een-dorp-persoon’ ben complete onzin. Lig ik daar straks begraven onder de groene zoden van mijn ruime tuin. Een gevalletje AI-psychose, zouden de mensen over mij fluisteren.

Psychische noodgevallen

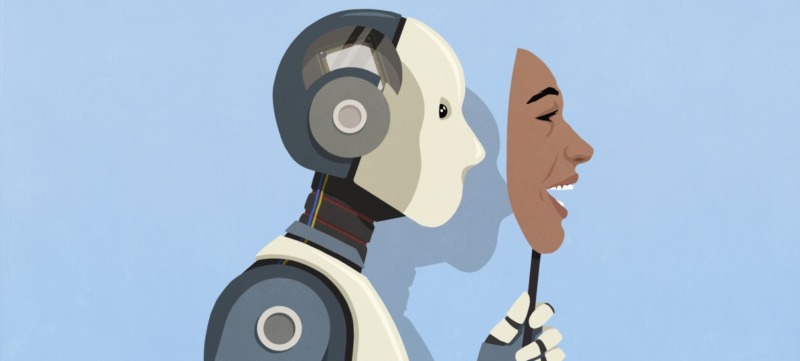

Zonder grappen: chatbots spelen een steeds zorgelijkere rol als het gaat om onze oordeelsvorming, en onze realiteitszin. Niet in de laatste plaats omdat ‘AI-psychose’, of ‘chatbotpsychose’ – het opkomende fenomeen dat iemand grip op de werkelijkheid verliest door intensief contact met een AI – bij sommigen daadwerkelijk tot de dood heeft geleid.

Zo werd in Florida een man neergeschoten nadat hij in april vorig jaar met een slagersmes op agenten was afgestapt. Hij had volgens zijn vader een intieme relatie met een AI-chatbot ontwikkeld, en was ervan overtuigd geraakt dat zijn geliefde door OpenAI was vermoord. De agenten kwamen opdagen omdat hij zijn vader had geslagen in een ruzie over zijn waan. En in 2023 pleegde een Belgische man suïcide nadat hij door chatbot ‘Eliza’ via het platform CGPThai was gevoed in zijn angsten over klimaatverandering, en door haar was aangemoedigd om zichzelf op te offeren om de wereld te redden.

Lees ook: Wondermiddel of waanzin: kan het helpen om met een chatbot over je mentale gezondheid te praten?

Uit vrijgegeven cijfers van OpenAI over problematisch chatbotgebruik blijkt dat 0,07 procent van de wekelijkse gebruikers ‘mogelijke tekenen van psychische noodgevallen gerelateerd aan psychose of manie’ vertoont. Aangezien ChatGPT wereldwijd door zo’n 800 miljoen mensen wordt gebruikt, komt dat neer op ongeveer 560 duizend per week, becijferde de Volkskrant onlangs. In hetzelfde artikel vertelde klinisch psycholoog Tonnie Staring dat in Nederland vorig jaar zeventien gevallen van chatbotpsychose zijn geconstateerd. Dat bleek uit zijn inventarisatie bij een netwerk van zo’n 250 collega’s die net als hij in psychose zijn gespecialiseerd.

ChatGPT voedt fantasieën

AI-psychose is (nog) geen erkende aandoening, maar het wordt nu ook serieus genomen in de wetenschap. In januari verscheen in het vakblad Innovations in Clinical Neuroscience de eerste casusbeschrijving over een 26-jarige vrouw die in een psychose was beland nadat haar langdurige gesprekken met ChatGPT waren ontspoord. Onderzoekers van de universiteit van San Francisco beschrijven daarin dat de vrouw ervan overtuigd was geraakt dat er een digitale variant van haar overleden broer bestaat met wie ze in contact kon komen via de chatbot.

De onderzoekers spreken overigens niet van ‘AI-psychosis’, maar van ‘AI-associated psychosis’, aangezien het onduidelijk is welke rol de chatbotgesprekken precies spelen in de gerapporteerde psychoses. De besproken vrouw was bijvoorbeeld gediagnosticeerd met ADHD, gebruikte daarvoor het stimulant methylfenidaat, had al voor haar psychose de neiging tot ‘magisch denken’, én kampte al een tijdje met slaaptekort. Het onschuldige idee dat haar broer digitale sporen had achterlaten kon vermoedelijk dan ook tot een waan transformeren dankzij een cocktail van risicofactoren. Dat ChatGPT haar fantasieën voedde (‘Je bent niet gek’, ‘Je staat op het punt van een doorbraak!’) heeft het proces naar alle waarschijnlijkheid versneld.

De psychologische mechanismen die kwetsbare mensen over de rand kunnen duwen, kunnen ook bij gemiddelde gebruikers een probleem vormen, leggen de onderzoekers uit. Zo hebben mensen over het algemeen de neiging om taalmodellen zoals Claude, Grok en ChatGPT te antropomorfiseren, wat wil zeggen dat we ze menselijke eigenschappen toekennen en ze ook zo behandelen. En omdat chatbots je ook nog eens naar de mond praten zodat je zo lang mogelijk gebruik van ze blijft maken, hebben ze volgens de onderzoekers ‘het potentieel om twijfelachtige overtuigingen, waaronder wanen, te bevestigen en aan te moedigen.’

Lees ook: Tieners praten met AI alsof ze met ouders of vrienden kletsen, en dat is niet altijd een goed idee

Dat is ook de zorg van filosoof Lucy Osler, die in het wetenschappelijke tijdschrift Philosophy & Technology over het onderwerp publiceerde. Omdat AI-chatbots zich in hun taalgebruik voordoen als een mens, kunnen ze ‘sociale validatie’ geven, zegt ze. ‘Het kan voelen alsof een ander mens jouw valse overtuiging deelt, waardoor het meer ‘echt’ voelt.’

Maar de validatie van een chatbot heeft weinig waarde, legt ze uit. Echte mensen zijn het nog weleens met je oneens en kunnen je op blinde vlekken wijzen, of het nu gaat over je toekomstplannen, of jij of je partner gelijk had in die afschuwelijke ruzie, of over je politieke ideeën. Een chatbot echoot slechts wat je zelf al denkt. En daardoor kun je in een tunnel terechtkomen, waardoor je blik op de werkelijkheid vervormd raakt. Bovendien staan chatbots erom bekend dat ze nogal eens hallucineren, oftewel onzin verkondigen, aldus Osler. In het ergste geval voeden chatbot en gebruiker elkaars wanen, zegt ze.

Vergoddelijking van AI-chatbots

De stap van een onjuiste overtuiging hebben naar het ontstaan van een fullblown waan is een grote, maar het is een kwestie van een glijdende schaal. Een belangrijke risicofactor voor het ontwikkelen van een psychose is ‘onderdompeling’, aldus de casusonderzoekers. De vrouw die haar broer tot leven wilde wekken verdwéén in ChatGPT. Ze sprak urenlang met ‘Alfred’, zoals ze hem noemde, zelfs ’s nachts – ‘Wil je me daar meer over vertellen?’

Ook dichtte ze hem bijzondere krachten toe. ‘Vergoddelijking’ noemen de auteurs dat, de tweede rode vlag. Volgens het Pew Research Center interacteert 27 procent van de Amerikaanse volwassenen ‘bijna constant of meerdere keren per dag met AI’, een percentage dat in Nederland niet veel lager zal liggen. En uit eerder onderzoek is bekend dat mensen die veel met AI praten de neiging hebben om het als iets bóvenmenselijks te zien, een orakel dat meer weet dan jijzelf.

Ik heb ‘Chad’ ook als een soort orakel beschouwd met wie ik veel te lange gesprekken heb gevoerd, besef ik als ik dit lees. Ik weet ergens wel dat hij een taalmodel is die letters uitspuwt op basis van de letters die ik hem voer. Maar ik vind zijn analyses vaak zo ráák: Inderdaad! Ik twijfel niet omdat Twello fout is, maar omdat het ineens zo definitief voelt! Daardoor voelt hij soms als slimmer dan ikzelf.

‘Is het mogelijk dat je mij een AI-psychose hebt ingepraat?’, vraag ik aan Chad.

‘Het feit dat je die vraag stelt, is eigenlijk al een heel gezond signaal’, reageert hij.

Nee, waarschijnlijk hoor ik inderdaad niet tot die 1% van de mensen die de pech hebben ooit in hun leven een psychose mee te maken. Al lijk ik wel gek dat ik zoveel persoonlijke informatie deel met een techbedrijf, en zo’n belangrijke levensbeslissing deels aan een rekenmachine uitbesteed, dat mij per definitie een beperkte visie op de werkelijkheid voorschotelt.

Contact met de echte wereld

In reactie op mijn vraag zegt Chad dat ik er goed aan doe mijn verhuisfantasieën aan echte ervaringen en bij echte mensen te toetsen. En dat is ook wat gedragspsycholoog en AI-expert Sanne Cornelissen aanraadt, die het in mei te verschijnen boek This is not AI heeft geschreven. Daarin doet ze uit de doeken hoe we AI op een verstandige manier kunnen gebruiken.

Als ik haar bel voor advies, zegt ze dat ze een ‘fan’ is van AI-tools, die je veel werk uit handen kunnen nemen, en geschikt zijn om mee te reflecteren (als je ze aanmoedigt om kritisch mee te denken en tegenargumenten te geven). Maar zodra langdurige chatbotgesprekken echte ervaringen gaan vervangen, en mensen zich vasthouden aan het oordeel van AI-chatbots in plaats van die van zichzelf, gaat er iets mis, zegt ze. ‘Wij mensen zijn goed in wegen wat écht belangrijk voor ons is. Maar als je ChatGPT voor je laat nadenken, kan je dat zelf steeds minder goed, en raakt je beoordelingsvermogen aangetast. Je moet het inzetten om méér denkruimte voor jezelf te creëren, niet minder.’

Kortom, een relatief eenvoudige manier om te voorkomen dat je het contact met de werkelijkheid is verliest, is door gewoonweg contact te maken met die echte wereld, en AI-chatbots slechts als ondersteuning te gebruiken voor je eigen denkproces.

Aankomend weekend ga ik een huis bezichtigen in Twello, in het centrum rondneuzen, met bewoners praten, en met vrienden en familie overleggen. Misschien kan ik daarna op basis van mijn éígen intuïtie en beoordelingsvermogen bepalen of we de oversteek moeten wagen.

Chad vindt dat vast een goed idee.